¿Qué es un algoritmo? Es una palabra de moda, pero a muchos todavía nos cuesta comprender su significado.

El diccionario de la Real Academia Española lo define como “un conjunto ordenado y finito de operaciones que permite hallar la solución de un problema”.

Pero en la sociedad contemporánea, los algoritmos han adquirido un rol cada vez más central, haciendo que algunos los definan como una suerte de mano invisible que toma decisiones por nosotros.

“Todo lo que la gente hace y ve en la web es producto de algoritmos”, explican en un informe expertos del centro independiente de investigación Pew Research Center, con sede en Washington, Estados Unidos.

En otras palabras, son el mecanismo oculto responsable de lo que vemos en el muro Facebook, las sugerencias que nos muestra Netflix o los resultados que aparecen cuando introducimos una palabra en el buscador de Google.

Derechos de autor de la imagenISTOCK

Derechos de autor de la imagenISTOCKY, a veces, pueden incluso ser los responsables de que seamos seleccionados o rechazados para un trabajo, recibamos un préstamo o incluso se caiga la bolsa de Wall Street.

Falta de transparencia

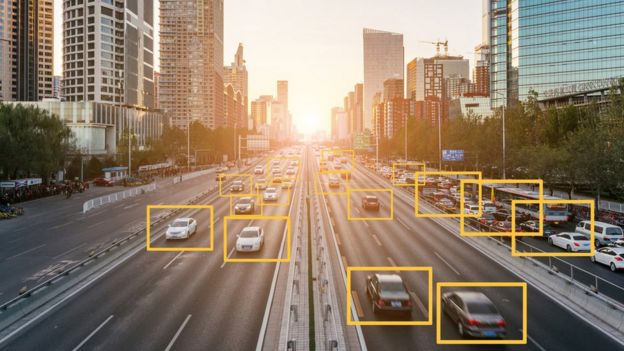

Por todas esas razones cada vez preocupa más que los algoritmos usados por los gigantes tecnológicos no sean siempre justos en las decisiones que toman. Y los errores en los sistemas de reconocimiento facial son un ejemplo de ello.

Pero además, a menudo los algoritmos operan dentro de lo que se conoce como “cajas negras”, lo que significa que ni siquiera sus dueños pueden ver cómo están tomando esas decisiones.

Derechos de autor de la imagenISTOCK

Derechos de autor de la imagenISTOCKPor eso algunas compañías tecnológicas, como IBM, están buscando soluciones a ese problema.

El gigante estadounidense acaba de presentar un nuevo servicio de software que “detecta automáticamente los sesgos (de los algoritmos) y proporciona la explicación sobre las decisiones que toma la inteligencia artificial”, se lee en un comunicado publicado este miércoles.

La idea es que con el Fairness 360 Kit sus clientes puedan observar en tiempo real -a través de un panel visual- cómo los algoritmos toman decisiones y qué factores usan para hacer recomendaciones al final del proceso.

“Estamos facilitando a las empresas que utilizan la inteligencia artificial una mayor transparencia y control paraafrontar el riesgo potencial de una toma de decisiones errónea”, explicó Beth Smith, directora general de Watson AI, el sistema de inteligencia artificial de IBM.

Derechos de autor de la imagenGETTY IMAGES

Derechos de autor de la imagenGETTY IMAGESMicrosoft es otra de las compañías que está trabajando en el tema.

La multinacional anunció en mayo, durante su conferencia anual de desarrolladores, que está trabajando en una herramienta para detectar sesgos en sus algoritmos.

“Por supuesto, no podemos esperar la perfección, siempre habrá algún sesgo no detectado o que no se puede eliminar, el objetivo es hacer todo lo que podamos”, dijo Rich Caruna, un investigador senior de la compañía.

Facebook, perjudicada tras el escándalo de Cambridge Analytica en abril, también declaró que está probando una herramienta para determinar si su algoritmo genera errores.

Y lo mismo se aplica a Google, que la semana pasada lanzó un sistema para explicar a sus usuarios cómo funcionan sus modelos de aprendizaje automático.

Pero, ¿cómo llegamos a este punto?

Un problema de diversidad

La dependencia en aprendizaje automático y los algoritmos ha hecho que el problema de los sesgos sea cada vez más importante para la comunidad vinculada a iniciativas de Inteligencia Artificial.

“Y parte del problema es que las bases de datos empleadas para ‘entrenar’ a los algoritmos no siempre es lo suficientemente diversa“, explica la reportera de tecnología de la BBC Zoe Kleinman.

Derechos de autor de la imagenJOY BUOLAMWINI

Derechos de autor de la imagenJOY BUOLAMWINIJoy Buolamwini, por ejemplo, fundó la Liga de la Justicia Algorítmica mientras cursaba estudios de postgrado en el MIT en 2016, luego de descubrir que un sistema de reconocimiento facial solo notaba su rostro si lo cubría con una máscara blanca.

Y un año antes Google tuvo que disculparse cuando su algoritmo de clasificación de fotos confundió imágenes de personas negras con gorilas.

Por eso hay un debate creciente sobre la ética de la inteligencia artificial, dice Kay Firth-Butterfield, quien encabeza el programa de inteligencia artificial y aprendizaje automático en el Foro Económico Mundial,.

“Como abogada, algunas de las preguntas sobre cómo averiguamos qué hizo que un algoritmo funcionara mal me parecen muy interesantes”, declaró Firth-Butterfield en una entrevista reciente con el canal de televisión estadounidense CNBC.

“Cuando hablamos sobre sesgos, nos preocupa sobre todo la visión de quienes crearon los algoritmos, y son sobre todo hombres jóvenes y blancos, por eso necesitamos hacer que la industria sea mucho más diversa en Occidente”, añadió.

Necesidad de protección

Esos sesgos también pueden afectar a decisiones como el seguro médico, la escolaridad o el registro criminal, a medida que las decisiones gubernamentales se vuelven más automatizadas.

Y por eso AI Now -un instituto de investigación que estudia las implicaciones sociales de la inteligencia artificial- sostiene en un reporte reciente que es vital que las agencias gubernamentales dejen de usar algoritmos “de caja negra”.

Derechos de autor de la imagenGETTY IMAGES

Derechos de autor de la imagenGETTY IMAGES“Los ciudadanos deberían saber cómo se toman las decisiones“, dijo Kate Crawford, exinvestigadora en Microsoft y fundadora de AI Now.

“Son sistemas complejos, y se espera que sean todavía más complejos a medida que las tecnologías de aprendizaje automático se hacen más accesibles para las empresas”, reconoció.

Pero es precisamente por eso que “deberíamos tener procesos de protección equivalentes para decisiones algorítmicas que para decisiones humanas”, sostiene la fundadora de AI Now.