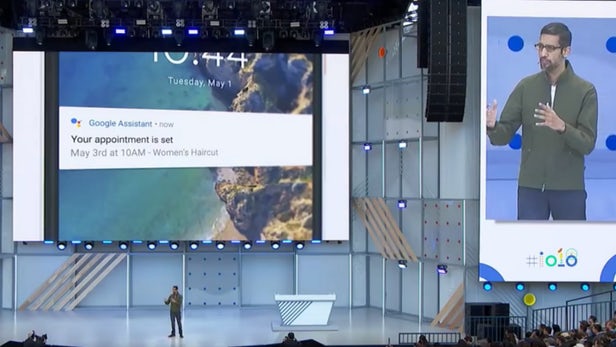

Hace unos días, en la conferencia anual de desarrolladores de E / S de Google, el gigante de las búsquedas reveló un nuevo sistema de IA denominado Duplex. El sistema interactúa con el Asistente de Google y, básicamente, puede participar en tareas simples de conversación a través de llamadas telefónicas a empresas, como programar una cita de peluquería o hacer una reserva en un restaurante. Sin embargo, no todo el mundo estaba contento con la presentación innovadora y una posterior protesta por las implicaciones éticas de una voz de IA que básicamente engañaba a los humanos para que pensaran que era humano ha llevado a Google a sugerir que el producto será programado para revelar su identidad informática en todo futuro utilizar

La demostración de la tecnología en la conferencia fue impresionante y sorprendente. El primer ejemplo mostraba que Duplex llamaba a una peluquería y programaba una cita (alrededor de 1 minuto en el video anterior). El segundo ejemplo involucró una conversación aún más compleja, con el sistema llamando a un restaurante para intentar hacer una reserva. En el curso de la conversación, se le dice al sistema que no necesitaría una reserva para tantas personas ese día en particular. Entendiendo esto, Duplex agradece a la persona del otro lado y cuelga.

Estos ejemplos de una IA humana que interactúa con una persona real son innegablemente impresionantes, pero la capacidad de la tecnología para engañar descaradamente a otro ser humano y hacerle pensar que es real ha dejado a muchos desconcertados.

Desde sugerencias de que Google había fallado en el diseño ético y creativo de la IA hasta acusaciones más explícitas de que la compañía estaba éticamente perdida, sin timón y completamente engañosa, parece que algo se había ido drásticamente mal. ¿Google había calculado completamente mal cómo se percibiría su nueva tecnología? ¿Fue este el caso de una compañía de Silicon Valley que desarrolló una tecnología en un vacío total sin darse cuenta de las implicaciones de su producto en el mundo real?